LoRA是一种十分强悍的技术,我们可能应当对它愈发关注。

论文地址:

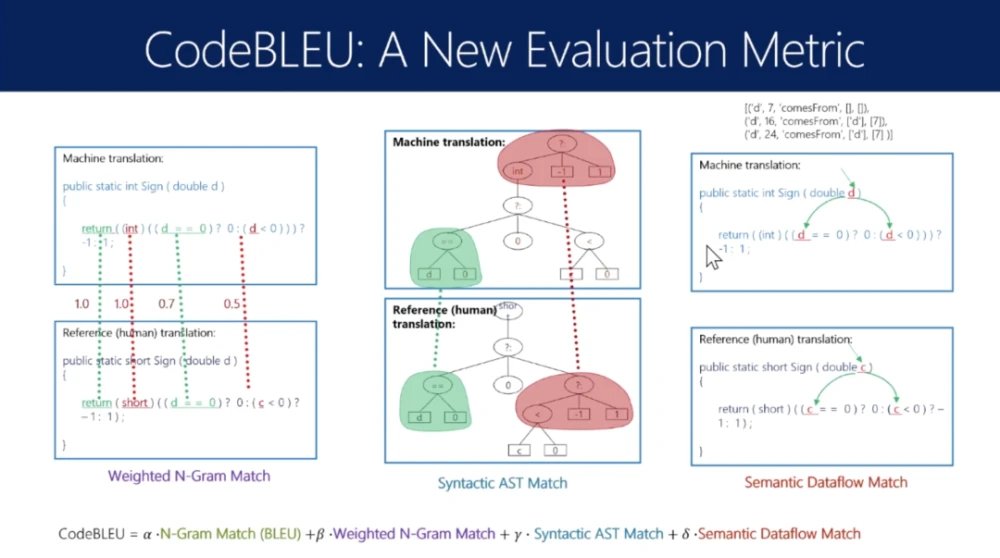

LoRA通过将模型更新表示为低秩分解来工作,这将更新矩阵的大小减小了数千倍以上。

这就让模型微调的时间和成本都大大减少。

若果在几个小时内,才能在消费级硬件上微调出一个个性化的语言模型,这件事的意义就太重大了。尤其是linux论坛,它还可以实时整合许多最新的、多样化的知识。

但这项技术在微软内部并未得到充分注重,虽然它直接影响了我们最寄寓厚望的项目。

从头开始重新训练模型,是一条艰辛的公路

LoRA这么有效的部份缘由在于,与其他方式的微调一样,它是可堆叠的。

可以应用指令调整改进模型,这样在其他贡献者添加对话、推理或工具时,就可以直接使用。

尽管单独的微调是低秩的,但它们的总和不须要,因而模型的全秩更新就可以随着时间的推移而累积。

这意味着,只要有新的、更好的数据集和任务出现,模型就可以以低廉的成本保持最新状态,无需支付完整运行的成本。

相比之下,从头开始训练巨型模型除了会丧失预训练的过程,都会丧失在底部进行的任何迭代改进。

在开源世界中,这种改进很快还会抢占主导地位,这促使全面重新训练模型的成本非常高昂。

我们应当考虑,每位新的应用或看法是否真的须要一个全新的模型?

假如我们真的有重大的构架改进,以至于难以直接重新使用模型权重,这么我们应当去投资更积极的分馏方式,来尽可能多地保留上一代模型的功能。

假如我们能否在小模型上快速迭代,这么从长远来看,大模型并不是强到无所不能

LoRA(小型语言模型的低秩适应)是谷歌提出的一种新颖技术,借以解决微调小型语言模型的问题。

它的更新对于最受欢迎的模型大小来说十分实惠(约100港元),这意味着几乎任何有看法的人都可以生成一个,并分发出去。

之后,三天之内训练一个模型都是平平事。

以这样的速率,用不了多久,这种微调的累积效应很快还会填补原先的模型大小的劣势。

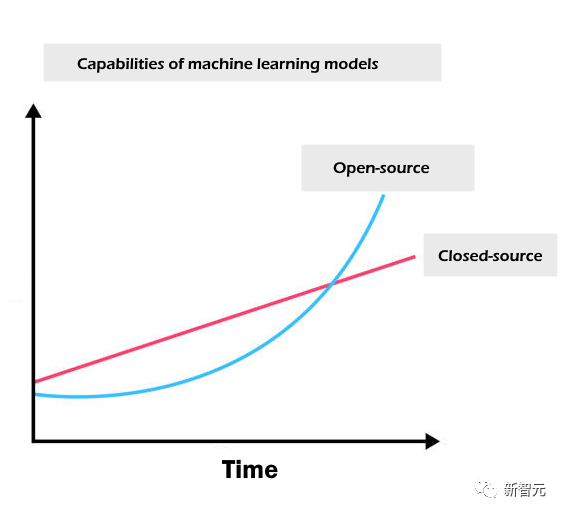

事实上google系统开源,这种模型的改进速率远远超过了我们使用最大模型所能做的,并且最好的模型与ChatGPT在很大程度上早已难以分辨。

专注于研究一些大模型,反倒让我们处于不利地位。

要数据质量,不要数据规模

许多项目通过对大型、精选数据集上进行训练来节约时间。这表明数据扩充规律具有一定的灵活性。

这样数据集的存在始于「DataDoesn'tDoWhatYouThink」一文中的思路,它们正迅速成为在微软之外进行训练的标准形式。

这种数据集是通过合成方式(例如,从现有模型中筛选出最佳响应)和从其他项目中搜集而建立。微软在这三者中都不占主导地位。

辛运的是,这种高质量的数据集是开源的,因而可以免费使用。

与开源直接竞争,是一个失败的命题

AI新进展对微软的商业战略有着直接、即时的影响。假如有一个免费的、高质量、且没有使用限制的代替品,谁会为微软产品付费?

但是我们不应当指望还能赶上。现代互联网之所以依赖开源,是有诱因的。开放源码有一些我们难以复制的明显优势。

比起她们须要我们,我们更须要她们

我们技术的保密仍然是一个脆弱的命题。

微软的研究人员正定期离开,抵达其他公司。所以我们可以假定她们晓得我们所晓得的一切。并且只要这条渠道是开放的,她们还会继续这样做。

然而,因为LLM的前沿研究成本低廉,保持技术领域的竞争优势显得愈发困难。

世界各地的研究机构都在互相借鉴,以广度优先的方法探求远远超出我们自身能力的解决方案空间。

我们可以试着紧紧捉住我们的秘密,而外部创新会消弱了其价值,又或则我们可以尝试着相互学习。

与公司相比,个人遭到许可的限制程度较小

最近,模型的创新大多在Meta的LLaMA模型权重泄漏以后进行的。

其实这肯定会随着真正的开源模型显得更好而改变,但关键是她们毋须等待。

「个人使用」所提供的法律保护以及控告个人的不切实际意味着,个人在这种技术炙热时能够获得这种技术。

作为自己的顾客意味着,你理解用例

浏览人们在图象生成领域中创建的模型,从动漫生成器到HDR水景,创造力源源不断地涌现下来。

这种模型由深入特定子类型的人使用和创建,赋于了我们难以企及的知识深度和共鸣。

拥有生态系统:让开源为我们工作

矛盾的是,大厂竞相争先的背后,赢家就是Meta。

由于泄漏的模型LLaMA是她们的,所以相当于她们有效地获得了整个星球价值的免费劳动力。

因为大多数开源创新都基于LLaMA,所以没有哪些能制止她们直接将其列入自己的产品中。

拥有生态系统的价值,未来将不可估量。以前的微软早已成功地在其开源产品(如Chrome和Android)中使用了这一范式。

通过拥有创新发生的平台,微软巩固了自己作为思想领袖和方向制订者的地位。

我们对模型的控制越严格,开源代替品就越有吸引力。

微软和OpenAI都倾向于严格控制模型使用,开启一种防御性的反应。

然而这些控制只是虚构的,由于任何企图将LLMs用于未经批准的目的的人,都可以选择自由提供的模型。

微软应当在开源社区中确立自己的领导地位,通过合作来发挥推动作用。

这可能意味着要采取一些令人不安的步骤,例如发布大型ULM变体的模型权重。这必然意味着舍弃对我们模型的一些控制。

但这些妥协是不可防止的。我们不能同时做到既促进创新,又控制创新。

结束语:OpenAI怎样样?

鉴于OpenAI目前的封闭新政,所有关于开源的讨论可能让人感觉不公正。

假如她们不乐意,我们为何要分享呢?但事实是,我们正通过源源不断地被挖角的中级研究人员与她们分享了一切。

在我们制止这股时尚之前,保密是没有意义的。

最后,OpenAI并不重要。

相对于开放源代码,她们正在犯同样的错误,她们保持优势的能力必然遭到指责。

除非她们改变立场,否则开源代替品可以google系统开源,但是最终会赶超她们。起码在这方面,我们可以先行一步。

开源时间线

23年2月24日,LLAMA发布

Meta发布LLaMA,开源代码,但没有公布权重。此时,LLaMA仍未进行指令或对话调优。

与许多当前模型一样,它是一个相对较小的模型(参数分别为7B、13B、33B和65B),经过相对较长时间的训练,因而与其大小相比具有相当强悍的能力。

23年3月3日,不可防止的事情发生了

不到一周,LLAMA就被泄漏给了公众。Meta现有的许可严禁将LLAMA用于商业目的。

忽然之间,任何人都可以进行试验。在整个社区,掀起了模型创新的海啸。

23年3月12日,语言模型在烤架上运行

一个多礼拜后,ArtemAndreenko成功在猕猴桃派上运行模型。当时,模型运行速率十分慢,由于权重必须在显存短发页,实用性不强。

虽然这么,这为一系列缩小模型规模的努力奠定了基础。

23年3月13日,电脑笔记本上的微调

第二天,哈佛发布了Alpaca,它为LLaMA降低了指令调优功能。

但是,重要的是,EricWang的alpaca-lora库房,它使用LoRA在单个RTX4090上几小时内完成了这个训练。

从这时起,忽然间,任何人都可以对模型进行微调,引起了一场关于低成本微调模型的竞争。

许多铺天盖地的报导称xxx模型总共耗费了几百美金。

更重要的是,低秩更新可以轻松地与原始权重分开分发,使她们甩掉了Meta原始许可的约束。任何人都可以分享和应用它们。

23年3月18日,显得更快了

GeorgiGerganov使用4位量化在MacBookCPU上运行LLaMA。

这是第一个「无GPU」解决方案,速率足够快,实用性很强。

23年3月19日,一个13B型实现了与Bard的「平衡」

第二天,一个跨学院的合作发布了Vicuna,并使用GPT-4驱动的评估对模型输出进行定性比较。其实评估方式值得怀疑,但该模型实质上比初期的变体更好。

最最重要的是,只用了300英镑进行训练。

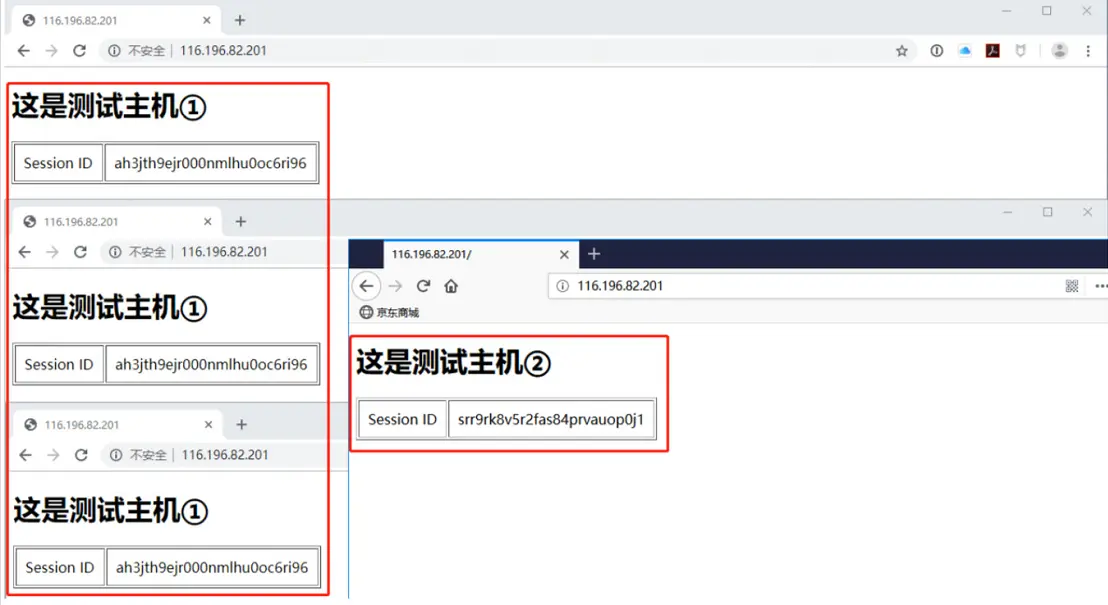

值得注意的是,她们才能使用来自ChatGPT的数据linux 论坛,同时规避其API的限制

她们只需从像ShareGPT这样的网站上获取令人印象深刻的ChatGPT对话样本。

23年3月25日,选择自己的模型

Nomic创建了GPT4All,它既是一个模型,更重要的是,它也是一个生态系统。

所有人第一次见到模型(包括Vicuna)汇集在一个地方。训练费用:100卢布。

23年3月28日,开源版GPT-3

Cerebras使用Chinchilla暗示的最佳估算计划和μ参数化暗示的最佳缩放(optimalscaling)来训练GPT-3构架。

这比现有的GPT-3克隆有很大的优势,代表了μ参数化在实际应用中的首次使用。这种模型是从零开始训练的,这意味着社区不再依赖LLaMA。

23年3月28日,一小时完成多模态训练

LLaMA-Adapter采用一种新的参数有效微调(PEFT)技术,在一个小时的训练中引入指令调优和多模态。

令人印象深刻的是,它们只使用了120万个可学习参数。该模型在多模态ScienceQA上刷新了SOTA。

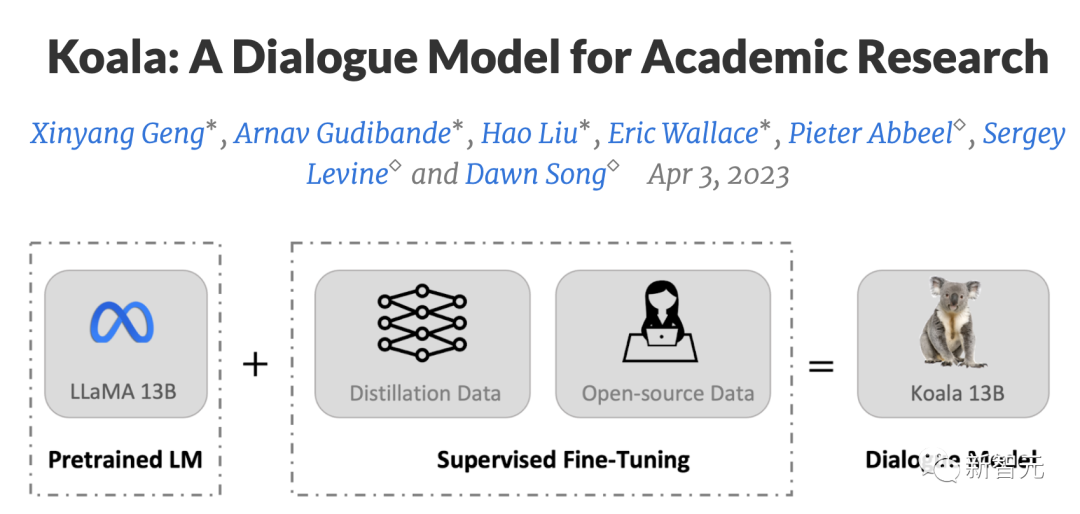

23年4月3日,人们难以分辨13B开源模型和ChatGPT

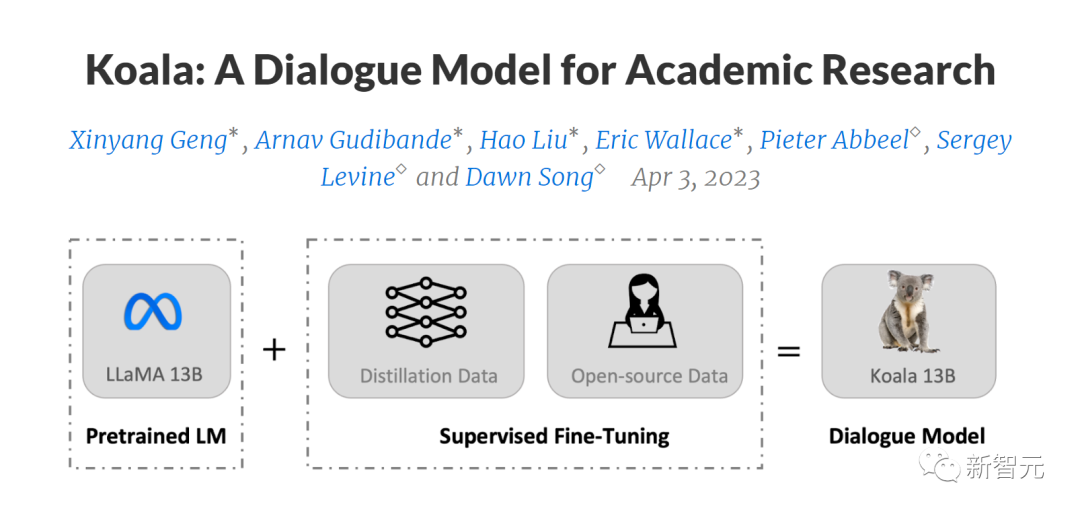

伯克利发布了Koala,这是一个完全使用免费数据进行训练的对话模型。

她们采取了评判真实人类在Koala和ChatGPT之间的偏好的关键步骤。

尽管ChatGPT依然稍占上风,但超过50%的时间,用户要么更喜欢Koala,要么无所谓。训练费用:100卢布。

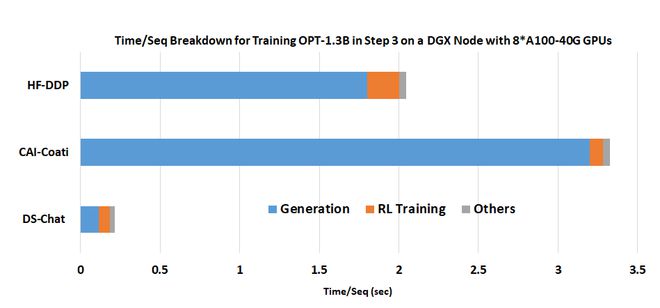

23年4月15日,ChatGPT级的开源RLHF

OpenAssistant发布了一个模型,更重要的是,发布了一个用于通过RLHF进行对齐的数据集。

这一模型在人类偏好方面接近ChatGPT(48.3%:51.7%)。

不仅LLaMA之外,她们还展示了这个数据集可以应用到Pythia-12B上,为人们使用一个完全打开的堆栈来运行模型提供了选择。

据悉,因为数据集是公开可用的,它促使对于大型实验者来说,RLHF从不可实现显得实惠,且容易。

微软筑墙,啪啪打脸

虽然开源是胜利,但现今的微软却反身架起瓮城,拒绝开源。

去年2月,常年兼任微软人工智能部门负责人JeffDean对内宣布了一项令人惊讶的新政转变: